human-pose-estimation-0006#

ユースケースと概要説明#

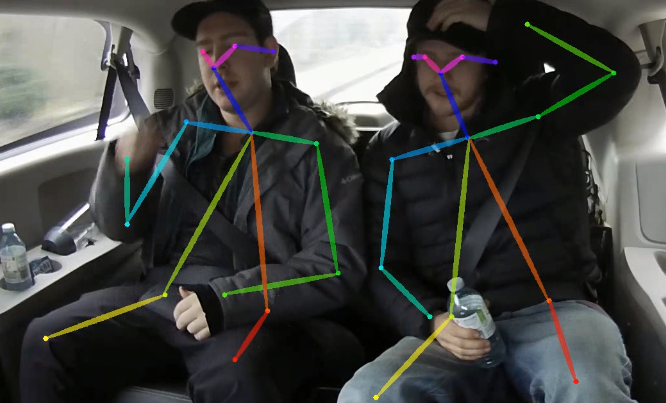

これは、EfficientHRNet アプローチ (Associative Embedding フレームワークに従う) に基づく複数の人物の 2D 姿勢推定ネットワークです。画像内のすべての人物について、ネットワークはポーズ、つまりキーポイントとキーポイント間の接続で構成される体の骨格を検出します。ポーズには、ears、eyes、nose、shoulders、elbows、wrists、hips、knees、ankles (耳、目、鼻、肩、肘、手首、腰、膝、足首) など、最大 17 個のキーポイントを含めることができます。

例#

仕様#

メトリック |

値 |

|---|---|

平均精度 (AP) |

51.1% |

GFlops |

8.844 |

MParams |

8.1506 |

ソース・フレームワーク |

PyTorch* |

COCO キーポイント評価サイトで説明されている平均精度メトリック。

入力#

画像、名前: image、形状: 1, 3, 352, 352、形式: B, C, H, W、ここで:

B- バッチサイズC- チャネル数H- 画像の髙さW- 画像の幅

予想される色の順序は BGR です。

出力#

最終出力は 2 つのブロブです:

すべてのタイプのキーポイントの位置ヒートマップを含む形状

1, 17, 176, 176のヒートマップ。非最大抑制アルゴリズムによって除外された位置には、否定値が割り当てられています。形状

1, 17, 176, 176, 1の埋め込みには、個々のキーポイントをポーズにグループ化する連想埋め込み値が含まれています。

デモの使い方#

このモデルは、Open Model Zoo が提供する次のデモで使用して、その機能を示します:

法務上の注意書き#

* その他の社名、製品名などは、一般に各社の表示、商標または登録商標です。