gaze-estimation-adas-0002#

ユースケースと概要説明#

これは、視線方向を推定するカスタム VGG のような畳み込みニューラル・ネットワークです。

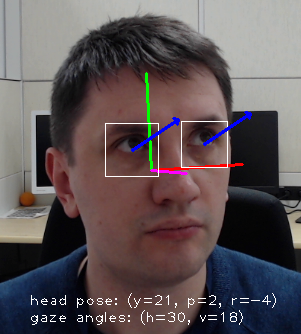

例と視線ベクトルの定義#

ネットワークは、左目画像の正方形クロップ、右目画像の正方形クロップ、および 3 つの頭姿勢角度 (ヨー、ピッチ、ロール) の 3 つの入力を受け取ります (図を参照)。ネットワークは、Z 軸が人物の目 (左右の目の中心点) からカメラの中心、Y 軸に向かうデカルト座標系で人物の視線の方向に対応する 3 次元ベクトルを出力します。y 軸は垂直であり、x 軸は z 軸と y 軸の両方に直交するため、(x, y,z) は右手座標系を構成します。

仕様#

メトリック |

値 |

|---|---|

GFlops |

0.139 |

MParams |

1.882 |

ソース・フレームワーク |

PyTorch* |

評価データセット#

異なる視線方向を持つ 60 人の画像を含む内部データセットからランダムに抽出された 2 人の個人。

検証結果#

視線方向の予測の精度は、グラウンドトゥルースと予測された視線方向の間の角度 (度単位) の MAE を使用して評価されます。

データセット |

MAE、度 |

AE の標準偏差、度 |

|---|---|---|

内部データセット |

6.95 |

3.58 |

入力#

ブロブ、名前:

left_eye_image、形状:1, 3, 60, 60、形式:B, C, H, W、ここで:B- バッチサイズC- チャネル数H- 画像の髙さW- 画像の幅

ブロブ、名前:

right_eye_image、形状:1, 3, 60, 60、形式:B, C, H, W、ここで:B- バッチサイズC- チャネル数H- 画像の髙さW- 画像の幅

ブロブ、名前:

head_pose_angles、形状:1, 3、形式:B, C、ここで:B- バッチサイズC- チャネル数

出力#

最終出力は、gaze_vector という名前と形状 1, 3 のブロブであり、視線方向ベクトルのデカルト座標が含まれます。出力ベクトルは正規化されておらず、単位長ではないことに注意してください。

デモの使い方#

このモデルは、Open Model Zoo が提供する次のデモで使用して、その機能を示します:

法務上の注意書き#

* その他の社名、製品名などは、一般に各社の表示、商標または登録商標です。